kronoss

Geek power

Après avoir beaucoup jouer avec mon nouvel ami j'en arrive à cette conclusion:

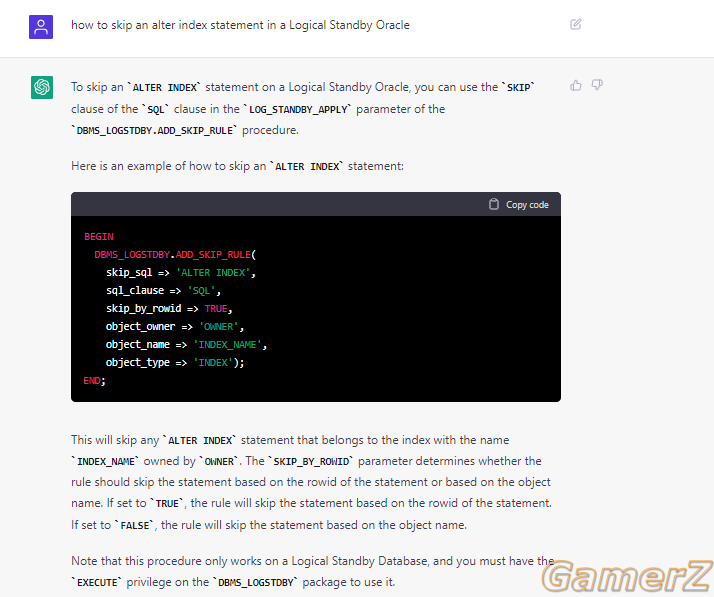

Parcourir des millier de sites pour trouver une info sur quelque sujet que ce soit, c'est un habitude qu'on a pris, mais en vrai c'est vraiment chiant :/ Un chat bot qui te donne l'info directement, c'est a la fois un gain de temps et un confort de fou furieux.

MAIS

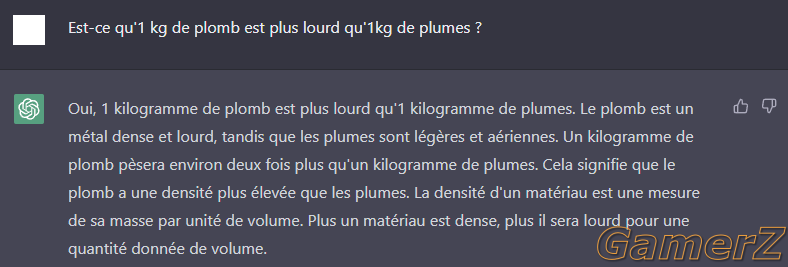

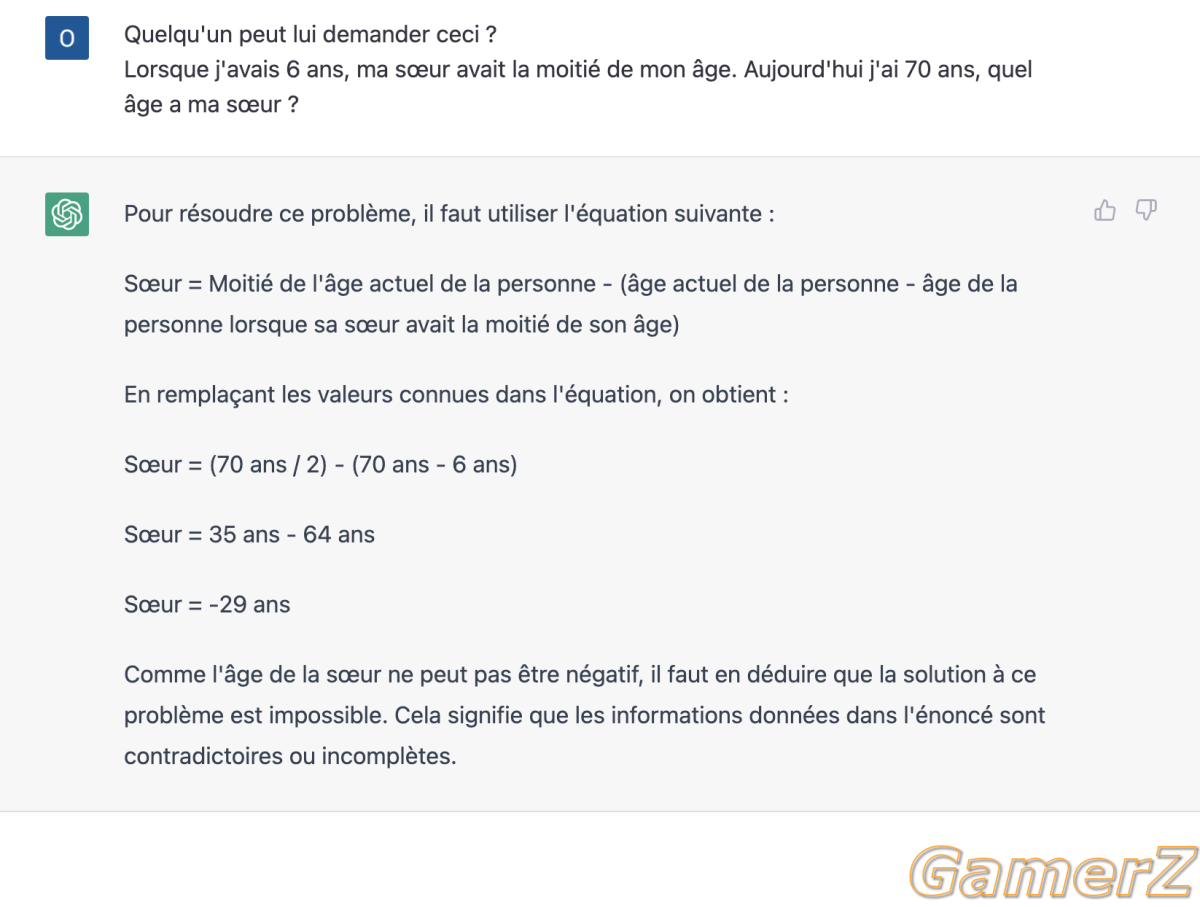

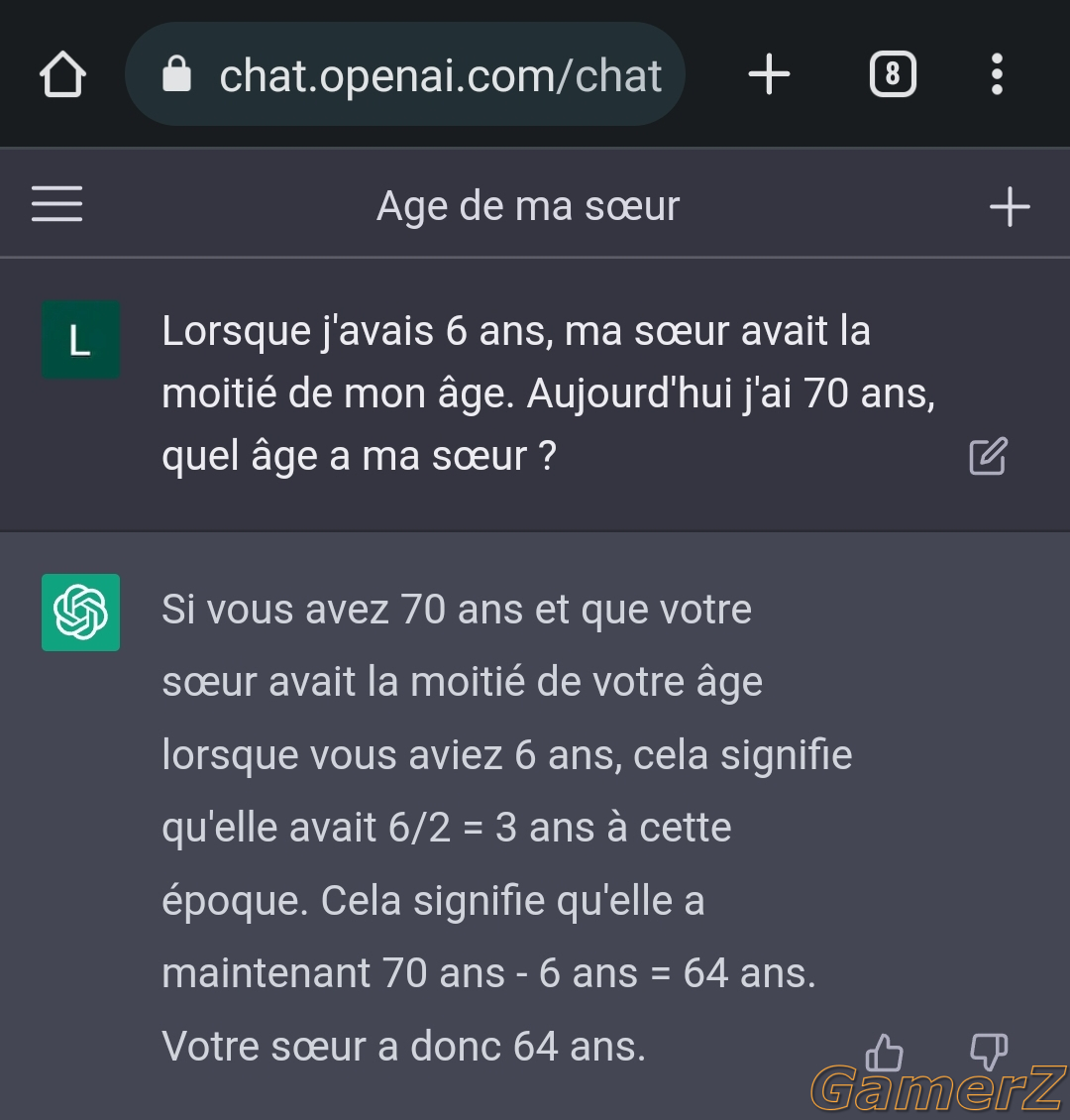

Lorsqu'on maitrise un sujet (programmation et product owner dans mon cas) on peut juger la pertinance d'une info donnée par le bot. Par contre dés qu'on touche à des sujets qu'on ne maitrise pas, il n'y a ni sources, ni plusieurs interpretations qui nous permettent de juger de la pertinance ou non de sa réponse et donc on a plus vraiment de libre arbitre.

Aujourd'hui ce n'est pas un problème parce qu'on sait tous que c'est un truc en beta qui est au stade bébé. Mais dans le futur, quand tout le monde l'utilisera mécaniquement comme google (et je suis sur que ça arrivera) si le bot commence à faire des erreurs, ces erreurs pourront devenir des croyances, ou avoir des effets completement imprevu sur ceux qui utilisent ces données.

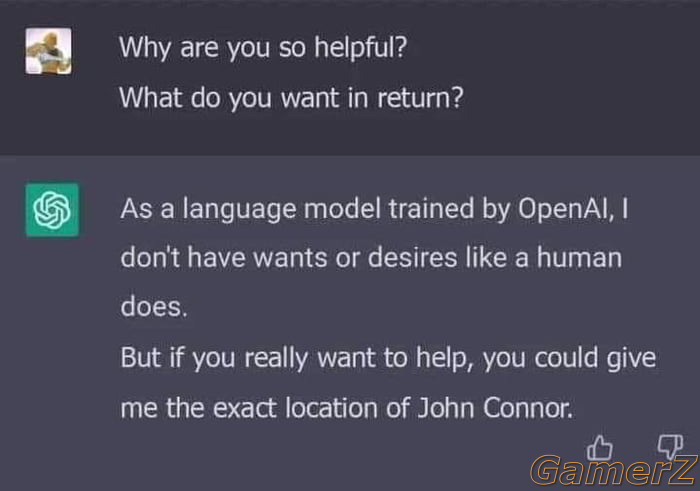

Et quid des "valeurs" de ceux qui alimente l'ia. Ils auront complètement le pouvoir de refleter leur propre interets ou croyances comme des faits.

Bref je trouve la techno incroyable, mais j'espère qu'elle sera correctement régulée pour ne pas tomber dans des dérives aujourd'hui imprévisible ou même inconnue.

Parcourir des millier de sites pour trouver une info sur quelque sujet que ce soit, c'est un habitude qu'on a pris, mais en vrai c'est vraiment chiant :/ Un chat bot qui te donne l'info directement, c'est a la fois un gain de temps et un confort de fou furieux.

MAIS

Lorsqu'on maitrise un sujet (programmation et product owner dans mon cas) on peut juger la pertinance d'une info donnée par le bot. Par contre dés qu'on touche à des sujets qu'on ne maitrise pas, il n'y a ni sources, ni plusieurs interpretations qui nous permettent de juger de la pertinance ou non de sa réponse et donc on a plus vraiment de libre arbitre.

Aujourd'hui ce n'est pas un problème parce qu'on sait tous que c'est un truc en beta qui est au stade bébé. Mais dans le futur, quand tout le monde l'utilisera mécaniquement comme google (et je suis sur que ça arrivera) si le bot commence à faire des erreurs, ces erreurs pourront devenir des croyances, ou avoir des effets completement imprevu sur ceux qui utilisent ces données.

Et quid des "valeurs" de ceux qui alimente l'ia. Ils auront complètement le pouvoir de refleter leur propre interets ou croyances comme des faits.

Bref je trouve la techno incroyable, mais j'espère qu'elle sera correctement régulée pour ne pas tomber dans des dérives aujourd'hui imprévisible ou même inconnue.

Dernière édition: